淺談關於AI繪圖趨勢...。

零、前言

人工智慧的發展涉及非常悠長的歷史,涉及到的數學理論非常非常大量。相較下我對此的理解非常淺薄,但還是想透過近期對AI的學習討論一下對於AI繪圖的感想。如果用最簡短的話語來概述的話就是,我認為繪師或設計師們對於生成式AI需要的是放寬心、與之共存的理念。AI繪圖絕對不是來殘害繪師,而是來協助繪師的工具。希望看完本文以後,不是很了解人工智慧的人能夠更了解,讓大家不要過度恐慌跟害怕。版權、盜用、商用等等的問題,在非AI的時代其實就已經存在,這是需要所有人共同一起維護跟承擔的命題跟使命。

一、神經網路?深度學習?人工智慧?

AI的歷史最早可以溯及到二戰後期,發展過程因為過去計算機速度不及所需的算力經歷幾度低潮,而如今計算機終於發展到足以將AI推上舞台甚至廣泛深入民間而非專為軍事或政府服務的工具。

那到底甚麼是人工智慧,甚麼是神經網路?其實網路包含維基已有相當大量的教學。可以參考JackJack大,介紹的超級淺顯易懂的系列文章:https://ithelp.ithome.com.tw/articles/10237868。

但我也想試著藉最近的學習用我的話描述看看。(原本已經懂的人就可以跳過這段了XD)

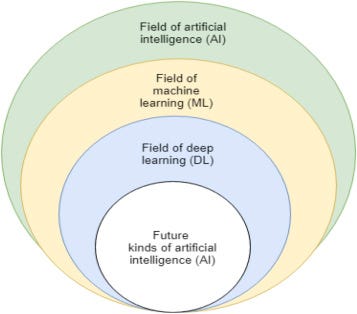

上圖所表現的是AI領域及其底下AI學習方法。而目前正在高度發展的正是其中DL(深度學習,Deep Learning)領域。這裡則涉及到神經網路(NN,Neural Network)。NN有很多種,但現今較常被提到的就屬以下兩個種類:CNN(卷積神經網路,Convolutional Neural Networks)及RNN(遞歸神經網路,Recurrent Neural Networks)。RNN的處理大部分用在語言、文本,目前我們熟知的ChatGPT就屬此領域,而CNN就屬圖像處理應用。(但近期ChatGPT的公司OpenAI也公布即將發布新版本的GPT4,該版本將可以處理影像、數學等等的功能。)

所謂人工神經網路其實是用數學的方式去模仿人腦的運作。簡單描述就類似我們國中所學的函式,只是神經網路的數學運算非常複雜,以至於產生現代人經常聽到的「演算法」。

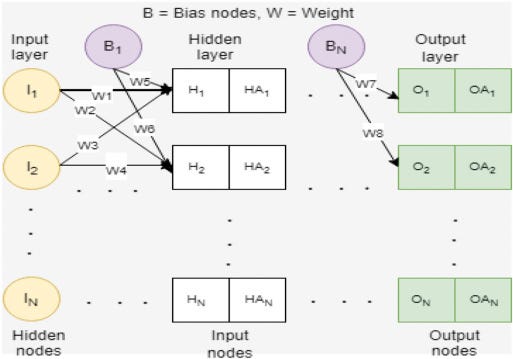

下方左圖就是神經網路的基本架構:分成輸入層、隱藏層、輸出層。輸入層的工作類似人腦的感官元(輸入語言、圖像、聲音等資訊),接收到的資料將經過複雜的隱藏層做處理,最終從輸出層產出函式的結果(執行動作)。其中節點(Nodes)模仿的便是人腦的神經元,權重(Weight)則用來連接節點之間,權重的數值大小將影響資料傳遞方向及函數的結果。深度學習則有豐富的神經元及複雜的隱藏層,模型更加複雜。

所以提到AI繪圖,不得不提到用來處理影像的CNN。

CNN是透過數學的方式來描述電腦看到的圖象。透過CNN不同層的結構及卷積的方式(類似濾波),電腦得以從一張圖片中獲得不同程度的特徵(這裡所指的特徵都是用數字的型態去表示),透過大量圖片的學習,更甚者讓他得以辨識圖像。最終,不同訓練方法訓練出來的CNN可以用來執行不同的工作,如:判斷樹葉的種類及健康程度、判斷人臉的基因疾病等等。(事實上我們常見Google的「我不是機器人」,然後要你點哪些是紅綠燈跟腳踏車的,正是在幫Google免費做AI訓練,所以Google真的是一家非常聰明的公司。)

再談到深度學習,深度學習的精神是以抽象的形式而非單一事件的思考,意即比起單純的表達數據更重視的是如何處理大量且複雜資料的過程。這樣的模型讓NN得以應用到更廣的地方,他可以被輸入人類過往不同種類的思考迴路並綜合地進行快速又大量的trial and error運算,幫助人類獲得嶄新的解法開創新的道路。現在NN已經被大量運用到不同領域,包括物理化學領域,EX. 幫助科學家加速催化的進展、太陽能發電站的設計建模、優化現行有的機器技術、對不同領域(如犯罪檢測、災害監控)進行預測、還原受損圖像......等等,非常多樣的應用。

二、所以AI不是抄東抄西…還是說學習本來就是一種模仿?

講這麼多,其實就是想表達NN的學習方式跟人腦學習的方式很像。他並不是單一的學習某張圖的「畫風」而是透過大量學習的方式去理解繪圖的「概念」,諸如筆觸的形狀、顏色的使用等等,是更general、更抽象的技巧,而不只是將人類可以分辨的幾張圖形拼拼湊湊。NN不像人類擁有喜好,人類會因為喜好跟興趣去影響自己的畫風、篩選自己想接觸的情報、向自己喜歡的繪師靠攏,然而NN則是照單全收,餵給他的他都吃。(當然也可能根據此NN的訓練人員自身的喜好受影響,因此訓練人員的客觀及素養就顯得非常重要。)故,長遠來看訓練有成的AI所生成的圖像,將會難以辨別他到底是如何運算與得出最後的圖像結果。

因此現在人們擔心的智慧財產權問題其實反過來看也很微妙,難道一般人學習臨摹、逛畫展的行為,也是在侵犯別人的著作權嗎?可以理解人們對於科技進步過快的不安跟害怕,但從消極的角度來看,整體的科技趨勢並不會因為藝術家的擔憂就停歇。就好比積體電路發展的摩爾定律一樣,人類的進步諸如量子計算機等等依然會不停地前進。但這真的不好嗎?反觀過去相機的出現並沒有取代肖像畫師們的工作,反而讓畫家們可以更專注在自己想發展的領域及藝術而非只是一昧地追求「畫得像及真實」。所以,就好比NN在其他領域的應用一樣,AI繪圖的出現勢必可以在一定程度上減少繪師們的工作量並有更好的發揮之處,究竟此技術要如何應用最終還是看回個人本身。

科學家及數學家們,也非常重視演算法的「透明化」。亦是希望透過剖析已經學習成功的NN去了解他的思維模式,就好比飽讀詩書的教授將他的學識教育給下一代一樣,科學家亦可透過NN訓練完成得出的運算方法,用NN的角度、當前人類沒有的角度去認識和預測現存的世界跟領域。同樣的道理,人們亦可以從優秀的AI裡學習到繪圖及構圖的技巧。不論是從圖像本身還是從該AI的演算法中得知,這些都是非常難能可貴的知識。

三、結語

在2019年,AI繪圖的討論還沒有現在這麼沸騰的時候,NVIDIA已開發了名為「GauGAN」的技術,利用不同屬性的畫筆,快速完成非常真實的圖像。上方右圖是Colie Wertz(美國資深概念美術師)利用此工具進行輔助最終完成的圖像。

補充一下:關於GAN這個技術是生成對抗網路(Generative Adversarial Network),該概念在2014年被提出。透過這個技術方式達成了圖像上的非監督式學習,該技術概念和現在的生成式AI存在絕對重要的關係。傳統機器學習可以被大概分成監督式學習與非監督式學習兩類。監督式學習需要透過人力標註資料進行「分類」,而非監督式學習就像沒有老師教卻要自己學會開車一樣,靠機器獨立學會「分群」方法。

近期金亨泰(劍靈藝術總監、命運之子遊戲美術)在個人推特發表了利用Stable Diffusion(AI)輔助繪圖並自己再用Adobe PhotoShop二次繪製過而完成的精美插畫(上圖)。

其實像這樣的繪圖演化進程,就類似過去繪師有一段時間也相當流行利用Blender建模輔助繪畫,快速搭建場景(現在還是相當流行就是)。若再追溯到更久以前,就彷彿電腦繪圖軟體剛被發明的年代,人們從紙上繪圖轉而跳到電腦上,利用電腦工具可以更快速修正圖像並且上色。這樣的歷史更迭只會不斷的重複上演,只是人們正在經歷更新一波的革新,大家還正在震盪之中。

當然只要新的科技出現,法律等等的問題便不會有止息的一天。回顧過去網路新型犯罪及網路霸凌等等的科技問題,現行法律都還難以透過流暢及正規的立法程序來追上現代文明的腳步。這自始至終從未改變,科技進步最考驗的還是人心。所以在這社會思潮的叉路上,如何做選擇、又該怎麼透過善的選擇影響他人,這將是每個現代人的重要使命及責任。

本文參考許多網路上關於人工智慧的說明文章,及 State-of-the-art in artificial neural network applications: A survey(Oludare Isaac Abiodun et al.,2018) (https://doi.org/10.1016/j.heliyon.2018.e00938)這篇期刊論文。